A reputação corporativa está passando por uma profunda transformação: ela não depende mais apenas do que as organizações comunicam, mas de como os algoritmos interpretam, reorganizam e amplificam as mensagens. Em um ecossistema dominado por mecanismos de busca com inteligência artificial, feeds personalizados e assistentes virtuais, a percepção pública é cada vez mais construída sobre leituras algorítmicas, e não apenas humanas. Na América Latina, essa dinâmica é especialmente crítica devido à alta polarização ideológica, à velocidade com que o conteúdo circula e à fragmentação e dispersão da mídia.

Relatórios de Clima Emocional (ECR) produzidos pela Delta Analytics BV, em parceria com a Latam Intersect, analisaram a percepção sobre Inteligência Artificial na mídia e no ambiente digital em Brasil, Argentina, Peru, Colômbia e México. Os dados mostram que a IA é percebida de forma ambivalente na América Latina, combinando expectativa e medo.

No ambiente digital, Brasil (36,66%) e Peru (34,49%) apresentam maior predominância de expectativa, com destaque para o Brasil, que também registra 34,48% de felicidade associada ao tema. Em contrapartida, o medo supera a expectativa na Argentina (43,60%), Colômbia (41,56%) e especialmente no México (53,89%). Já no noticiário, a expectativa cresce na Argentina (49,07%), no Brasil (45,81%) e no Peru (40,36%), enquanto o medo permanece dominante no México (58,72%) e elevado na Colômbia (41,9%). O conjunto dos dados evidencia que a percepção sobre IA varia conforme o país e o ambiente informacional, reforçando a importância de narrativas claras, contextualizadas e consistentes para a construção da reputação corporativa.

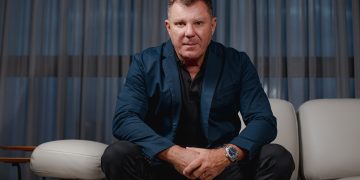

“Hoje, os algoritmos não apenas distribuem conteúdo, como também moldam a percepção pública de uma marca ou instituição. Essa é a mudança estrutural: a reputação não se constrói mais apenas com base no que dizemos, mas também em como os sistemas interpretam o que dizemos”, explica Roger Darashah, sócio e cofundador da Latam Intersect. Ou seja, isso significa que um comunicado de imprensa, uma entrevista ou uma declaração pública podem ser resumidos, reinterpretados ou enquadrados por modelos de IA que eliminam sutilezas e priorizam aspectos emocionais, influenciando diretamente a forma como o público, jornalistas e stakeholders entendem uma organização.

A partir de 2026, essa lógica se intensifica. Os algoritmos tendem a amplificar o conteúdo que desencadeia emoções como indignação ou surpresa, e a minimizar o conteúdo que classificam como controverso, mesmo quando relevante. Além disso, as interpretações iniciais que circulam frequentemente estabelecem a narrativa dominante, mesmo quando informações mais precisas surgem posteriormente. Isso torna a reputação mais instável, mas também mais previsível para organizações que entendem quais sinais os sistemas priorizam: clareza da mensagem, consistência narrativa, rapidez de resposta e apoio de fontes confiáveis.

Se os algoritmos, agora, são coprodutores de reputação, como a narrativa é gerenciada quando parte dela não é mais controlada pela organização, pela mídia ou pelo público, mas pelo próprio sistema?

A região enfrenta novos riscos de reputação impulsionados pela Inteligência Artificial. Deepfakes políticos e corporativos, campanhas automatizadas que simulam consenso e desinformação cada vez mais profissionalizada estão corroendo a confiança pública de forma mais silenciosa e eficaz. “A desinformação não é mais um acidente. Hoje, as organizações não enfrentam rumores espontâneos, mas campanhas planejadas que usam tecnologia, segmentação e narrativas projetadas para parecerem legítimas”, alerta Claudia Daré, fundadora e diretora da Latam Intersect. Em mercados polarizados com lacunas regulatórias, esses ataques podem semear dúvidas sem a necessidade de viralização em massa ou acusações explícitas.

Diante desse cenário, as organizações que conseguem manter sua reputação não são aquelas que reagem mais rapidamente, mas sim aquelas que constroem narrativas estáveis e verificáveis antes que uma crise ocorra. Consistência, documentação pública, alinhamento de porta-vozes e clareza de propósito tornam-se ativos estratégicos porque alimentam os algoritmos com sinais consistentes, reduzindo o espaço para interpretações errôneas ou maliciosas.

Ética Narrativa como pilar reputacional

Transparência, verificabilidade e responsabilidade não são mais apenas valores corporativos; agora funcionam como sinais técnicos que os sistemas de IA reconhecem e priorizam. “Em 2026, o verdadeiro desafio não será quantas ferramentas de IA as organizações usam, mas sim o quão ética, coerente e bem estruturada é sua estratégia de comunicação principal. Somente as marcas que combinarem sensibilidade humana com IA e narrativas autênticas serão capazes de construir reputações sólidas”, afirma Claudia Daré.

Em um ambiente dominado por agentes autônomos, busca conversacional e distribuição algorítmica, a reputação é construída diariamente. “A IA pode acelerar uma crise ou fortalecer uma reputação, mas tudo depende da base que fornecemos. Se a narrativa for sólida e coerente, a tecnologia a amplifica. Caso contrário, ela a expõe. A reputação do futuro não é improvisada: é construída todos os dias”, resume Darashah.

Para empresas, marcas e organizações na América Latina, a mensagem é clara: entender como os algoritmos pensam é tão importante quanto entender o público, e aqueles que integrarem ética, consistência e estratégia em sua comunicação serão os que conseguirão manter — e liderar — a confiança na era da IA.